AI换脸之辨:破假防骗指南

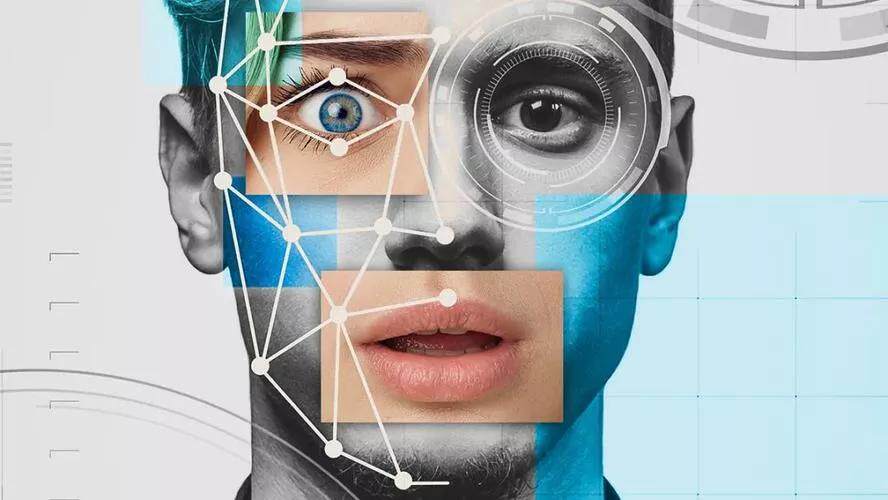

AI 换脸:技术之魅与风险之影

AI 换脸技术在当今时代发展迅速,凭借其逼真的效果和广泛的应用场景,成为了科技领域的热门话题。如今,AI 换脸技术已经能够实现高度逼真的人脸置换,只要拿到一张人物正脸照片,就可以完成换脸,甚至能做到实时视频通话换脸,达到了以假乱真的程度。在电影制作中,AI 换脸技术为特效化妆和数字合成提供了新的手段,能够更高效地完成角色形象转换,为电影创作提供更广阔的想象空间。在游戏领域,玩家可以借助 AI 换脸技术迅速创造个性独特的虚拟形象,增加游戏的吸引力和趣味性。此外,AI 换脸技术在娱乐行业也有广泛的应用,例如可以让用户足不出户就能出一套写真集。

然而,AI 换脸技术在带来便利和创新的同时,也带来了一系列风险。首先,AI 换脸技术可能被用于诈骗。例如,骗子通过 AI 换脸和拟声技术,佯装亲戚对其实施诈骗。宁夏固原警方接到辖区居民马某某报案称自己被在非洲务工的 “表哥” 骗了 1.5 万元,原来视频连线的 “表哥” 是利用 AI 技术换脸的 “冒牌货”。其次,AI 换脸技术可能侵犯个人隐私。随着人工智能技术快速发展,相关的 AI 应用正在影响人们生活的方方面面,这也给个人信息保护带来了新的挑战。近日,浙江杭州警方就侦破了全国首起利用 AI 技术侵犯公民个人信息的案件。犯罪团伙利用人工智能,使用 “AI 换脸技术” 可以突破平台登录的识别验证,从而强制登录别人的头部平台账号,定向获取用户留存于平台的全量信息。最后,AI 换脸技术还可能被用于制作、贩卖淫秽物品牟利。在北京警方侦破的一起案件中,犯罪嫌疑人白某某使用 AI 去衣技术,制作、贩卖淫秽物品,将他人提供的承载人脸信息的特定多数女性图片,通过深度制造技术 AI 软件制作成裸体图片贩卖牟利。

此外,AI 换脸技术还可能引发一系列伦理和法律问题。在网络社区中,换脸软件被滥用于制造不实言论和恶劣闹剧,严重侵犯了他人名誉权乃至引发法律纷争;大量未经授权的图片被随意调用,导致公民隐私信息面临泄漏风险,对现代社会造成极大治安挑战;犯罪分子利用此项技术伪造新闻事件或视频素材,严重威胁公民及社会的生命财产安全。

综上所述,AI 换脸技术虽然具有强大的魅力,但也存在着不可忽视的风险。我们在享受 AI 换脸技术带来的乐趣和便利的同时,也应该提高警惕,加强对个人信息的保护,防范 AI 换脸技术可能带来的风险。

AI 换脸技术原理

AI 换脸技术主要包含三个主要步骤:

- 人脸的识别追踪:使用深度学习算法精准识别视频当中的人脸图像。在这个过程中,就像一个敏锐的探测器,能够迅速定位到图片或视频中的人脸位置。例如,技术人员用手机给记者拍一张脸部照片,导入 AI 人工智能软件后,软件能够快速追踪到照片中的人脸。

- 面部特征提取:采集图像中人脸的眼睛、鼻子、嘴巴这些关键的面部特征。这些特征是每个人面部的独特标识,通过对它们的提取,可以为后续的换脸操作提供准确的依据。比如,将这些特征与目标的人脸图像进行匹配,实现面部信息的替换。

- 人脸变化融合:将原始照片进行变换、融合和整形。如果有大量照片被存储下来,后期还可以把这些照片合成一段简短的视频进行发布。就像一个神奇的魔术师,把不同的面部元素融合在一起,创造出逼真的换脸效果。

目前,“AI 换脸” 技术比较成熟,只要拿到一张人物正脸照片,就可以实现换脸,甚至能做到实时视频通话换脸,达到了以假乱真的程度。除了换脸,如果再结合着换背景环境、换音频,逼真度就更高了。

AI 换脸诈骗案例频发

AI 换脸技术被不法分子利用,导致诈骗案例频发,给人们带来了严重的危害。

比如,内蒙古包头警方通报,某公司法人代表郭先生 10 分钟内被骗 430 万元,犯罪分子就是通过 “AI 换脸” 和拟声技术佯装熟人实施诈骗。福州市某科技公司法人代表郭先生被好友通过微信视频联系,称朋友在外地竞标需要保证金,郭先生基于信任且视频聊天核实身份后,未核实钱款是否到账就转了 430 万,后发现被骗,骗子极有可能通过技术手段盗用好友微信,发起视频聊天实施诈骗。

还有常州的陆女士在 QQ 上收到自称亲戚的好友添加申请,对方称人在国外转账汇款会延迟,让陆女士帮忙支付机票尾款,视频通话时陆女士看到确实是亲戚本人但听不到讲话,出于对人脸的信任陆续汇款 10 万余元,后才发现上当。

山东省济南市商河县的黄某某在家刷短视频时收到表哥私信,添加 QQ 后表哥以身份不便为由让黄某某帮朋友转大额资金,黄某某收到 “转账凭证” 但未收到转款,后与表哥视频通话看到和表哥一模一样的人,因对方声音低且十几秒后称有会议挂断,黄某某确信身份后转了 30 余万元,后发现被骗报警。

香港一家跨国公司香港分部的职员受邀参加总部首席财务官发起的 “多人视频会议”,按照要求先后转账 2 亿港元,后发现只有自己是真人,其他 “参会人员” 都是经过 “AI 换脸” 后的诈骗人员。陕西西安财务人员张女士与老板视频通话,老板要求转账 186 万元,转账后发现被骗,警方紧急止付保住大部分被骗资金。

这些案例充分说明,AI 换脸技术被不法分子利用后,诈骗手段越来越多样化,危害也越来越大。我们在日常生活中一定要提高警惕,防范此类诈骗。

如何辨别 AI 换脸

AI 换脸技术以假乱真,给人们带来了诸多风险,因此掌握辨别方法至关重要。

(一)动作识别法

可以要求对方在视频中挥手、快速抬头、低头、左右转头等动作。实时伪造的视频,在这些动作过程中,会造成面部的数据干扰,所伪造的人脸会产生一定的抖动或者闪现,或者是一些异常情况。比如技术人员展示 AI 换脸技术时,随着面部表情变化,换脸后的照片会跟着一起发生相应变化,但如果做一些特定动作,换脸后的图像可能会出现异常。

(二)细节观察法

仔细观察对方视频中的光线背景、面部轮廓等细节是否自然。假脸的嘴部运动不自然,人的嘴部运动最快最频繁,软件在这方面往往难以做到完全自然的渲染;假脸的眼睛无法精确复制正常人的眨眼间隔和用时,正常人眨眼间隔 2 到 10 秒,眨眼用时 0.1—0.4 秒,而假脸在这方面容易露出破绽。同时,还可以观察视频中人物的发型、眼睛、嘴巴等部位是否与初始视频出现不同,若有不同很可能经过了 AI 换脸。另外,注意观察视频的背景以及环境是否与人物身份相符,若不相符,则可能是使用了 AI 换脸技术。

(三)问答验证法

问一些只有对方知道的问题,验证对方的真实性,或者采用和对方之前约定好的暗号去验证。针对存疑的、所谓的 “领导” 或 “熟人”,可以通过其他渠道进一步验证,包括打电话或者向对方的亲朋好友,去确认其真实身份和情况。还可以提示对方用手遮挡脸部,软件无法及时渲染,对方会被当场拆穿。同时,在摁鼻子或摁脸的同时左右摇晃头部,由于很多 “AI 换脸” 的基础是被模仿者的照片,照片是平面的,当人脸动起来时,会呈现出脸部的三维结构,算法只能基于平面的照片推测三维结构,按照现有的技术手段,会产生破绽。

防范 AI 换脸诈骗的方法

随着 AI 换脸技术的发展,诈骗手段层出不穷,掌握有效的防范方法至关重要。

(一)保护个人信息

在当今数字化时代,个人信息的保护变得尤为重要。我们应加强个人信息保护意识,不轻易提供人脸、指纹等个人生物信息,因为这些信息一旦落入不法分子手中,就可能被用于 AI 换脸诈骗。同时,不随意下载陌生软件,陌生软件可能携带恶意程序,窃取个人信息;不添加陌生好友,避免被不法分子盯上;不扫描不明二维码,防止进入钓鱼网站,导致个人信息泄露。

(二)多重验证转账

在涉及转账汇款等金融交易时,我们不能仅仅依赖视频通话确认对方身份。可通过其他相对可靠的方式确认对方身份,如亲自打电话等。在确认过程中,可以问一些只有对方知道的问题,进一步核实身份。并且将转账时间设定为 “24 小时到账”,这样即使发现被骗,也能有时间采取措施,避免资金立即到账造成更大损失。最好向对方银行账户转账,避免通过微信等社交软件转账,以便更好地追踪转账信息,核实对方身份。

(三)宣传防范工作

我们要多多提醒、告诫身边的亲朋好友,做好宣传防范工作,共同预防受骗。向他们介绍 AI 换脸诈骗的常见手段,如骗子伪装成亲人、朋友、同事、领导等,虚构紧急事由实施诈骗。提醒他们在接到涉及转账等要求时,要保持警惕,多重验证对方身份。特别是对不熟悉新兴技术的中老年人,要加强常规反诈提示,揭示不法分子的新手段,让他们明白视频电话眼见、耳听未必属实,勿与陌生人视频通话,个人信息切不可轻易对外提供。

(四)及时报警处理

遇到被骗或可疑情形,请注意保护证据并立即报警。保存好聊天记录、转账凭证、视频通话记录等证据,为警方侦破案件提供线索。及时报警可以争取时间,让警方采取紧急止付等措施,尽可能挽回损失。同时,也能让警方及时掌握诈骗动态,加强防范和打击力度。

AI 换脸的合规使用领域

AI 换脸技术虽然存在风险,但在娱乐行业和商业途径也有一些合规的应用。现在应用比较广泛的是在娱乐行业,例如可以让用户足不出户就能出一套写真集,为大家带来了全新的娱乐体验。除此之外,AI 换脸技术在影视制作中也发挥着积极作用,为角色塑造提供了更多可能性。

然而,这项技术确实是一把 “双刃剑”,如果被别有用心的人、不法分子利用可能就会造成很大的危害,所以合规的监管确实很重要。用户在使用 “AI 换脸” 技术时,尽量选择大公司、大平台推出的产品。大公司和大平台通常有更严格的安全措施和监管机制,能够更好地保护用户的个人信息。同时,尽量不通过来路不明的渠道上传自己的个人信息,以免个人信息被不法分子窃取利用。

空空如也!